Какие типы данных необходимы для качественной Ai персонализации маркетинга?

Для эффективной Ai персонализации маркетинга требуется многослойный набор данных, который позволяет моделям точно предсказывать поведение пользователей и формировать релевантные предложения. В первую очередь это первичные пользовательские данные: идентификаторы клиентов, демография, история покупок, просмотры страниц, взаимодействия с письмами и push-уведомлениями, время сессий и источники трафика. Во-вторых, поведенческие сигналы в реальном времени: клики, скроллы, конверсии и отказы. В-третьих, контекстные данные: устройство, геолокация, время суток и сезонность, которые дают модели понимание ситуации показа контента. В-четвертых, метаданные о товарах и услугах: категории, цены, наличие на складе, рейтинги и отзывы, которые позволяют персонализировать продуктовые рекомендации. В-пятых, внешние данные: погодные условия, праздники и экономические индикаторы, которые могут усиливать модели прогнозирования спроса. Важно отметить следующие требования к данным:

1. Качество и полнота — отсутствие дубликатов, корректные таймстемпы и единые идентификаторы пользователей.

2. Нормализация и семантическая унификация — единые наименования событий и атрибутов.

3. Наличие долгой истории взаимодействий — минимум несколько месяцев, оптимально 12 месяцев для сезонных паттернов.

4. Метки бизнес-результатов — конверсии, LTV, возврат средств для обучения задач с учителем.

Технически данные подаются через интеграционные каналы: API, трекинговые пиксели, colis, выгрузки из CRM и ERP, потоковые коннекторы. Мы рекомендуем внедрять слой единого клиента (CDP) для агрегирования и обогащения событий перед подачей в моделирование. В Волжском процесс подготовки данных включает очистку, дедупликацию, анонимизацию и обогащение признаков. Без хорошо подготовленных данных даже самая продвинутая модель даст неустойчивый результат, поэтому этап сбора и валидации данных — ключевой при запуске персонализации.

Какие AI-модели и алгоритмы применяются для персонализации маркетинга и в чем их отличие?

Для персонализации маркетинга мы используем комбинацию моделей, каждая из которых решает специфические задачи и дополняет другую, создавая гибкую систему рекомендаций и триггеров. Основные классы моделей:

1. Модели коллаборативной фильтрации и факторизации матриц — эффективны для рекомендаций на основе сходства пользователей и товаров; быстро масштабируются и даёт хорошие рекомендации в условиях плотной матрицы взаимодействий.

2. Модели на основе контента — используют семантику описаний товаров, категорий и атрибутов для рекомендаций похожих по смыслу товаров; важны на этапе холодного старта для новых товаров.

3. Гибридные системы — объединяют коллаборативные и контентные подходы, что повышает точность и устойчивость в различных сценариях.

4. Sequence modeling (RNN, Transformer) — учитывают порядок взаимодействий пользователя, подходят для предсказания следующего действия и генерации персонализированных сценариев коммуникации.

5. Модели обучения с подкреплением — оптимизируют долгосрочные KPIs, такие как LTV и удержание, через последовательные тесты вариантов и подбор стратегии предложений.

6. Классификаторы и регрессоры (GBM, LightGBM, CatBoost) — прогнозируют вероятность конверсии, отклика на кампанию или величину чека.

7. Кастомные ансамбли и AutoML-проекты — позволяют автоматизировать подбор фичей и гиперпараметров, повышая стабильность.

Ключевые отличия: скорость обучения и отклика, требования к объёму данных, интерпретируемость, устойчивость к смещению данных и способность к онлайн-обновлению. Например, факторизационные модели быстрее и просты, но хуже работают при холодном старте; трансформеры дают лучшую контекстную картину, но дороже в вычислениях. При интеграции мы проектируем стек так, чтобы модели перекрывали слабые места друг друга и обеспечивали как сразу применимые рекомендации, так и стратегическую оптимизацию показов и бюджета. Инфраструктура допускает онлайн-сервисы для real-time inference и пакетную обработку для периодических обновлений, а также мониторинг дрифта и ретренинг по расписанию в мае.

Как происходит анонимизация и защита пользовательских данных при построении персонализации?

Защита и анонимизация данных — обязательный компонент любой системы персонализации, и её реализация должна соответствовать правовым и техническим требованиям. Мы применяем многоуровневый подход: политиками доступа, техническими мерами и процедурой обработки данных. На техническом уровне используются методы анонимизации: псевдонимизация идентификаторов, удаление персональных атрибутов (имена, контактные данные) из аналитических наборов, агрегирование по когорте при обучении моделей и применение дифференциальной приватности для задач, где требуется строгая математическая гарантия приватности. Также внедряются процедуры минимизации данных: храним и обрабатываем только те атрибуты, которые необходимы для конкретных моделей, и ограничиваем сроки хранения по политике ретенции. Для защиты передачи данных применяются шифрование TLS/HTTPS, VPN-каналы для обмена между сервисами и шифрование данных в покое на уровне диска. Контроль доступа реализуется через роль-ориентированные политики и аудит логов: доступ к сырьевым данным имеют только узкие группы инженеров и аналитиков, при этом доступ к анонимизированным агрегированным данным шире. Правовые и процедурные меры включают цифровые соглашения и соглашения об обработке данных с поставщиками, регулярные DPO-ревью и соответствие региональным требованиям по защите персональных данных. При необходимости для отдельных сценариев мы используем on-device inference, когда персонализация происходит на устройстве пользователя, и только аггрегированная статистика отправляется на серверы, что снижает риски утечек. В документации и при внедрении мы проводим оценку влияния на защиту данных и предоставляем рекомендации по хранению, доступу и соответствию требованиям региона в Волгоградской области. Отправьте запрос КП Геннадию Олеговичу чтобы получить подробную карту защиты и предложенные архитектурные решения.

Какие метрики и KPI применяются для оценки эффективности Ai персонализации и как корректно интерпретировать результаты?

Оценка эффективности персонализации требует набора как моментальных, так и долгосрочных метрик, а также корректного дизайна экспериментов. Базовые короткосрочные метрики включают: CTR на рекомендованные блоки, CR (конверсия из показа в покупку или лид), AOV (средний чек), и уменьшение bounce rate на ключевых страницах. Среднесрочные и долгосрочные KPI: LTV (пожизненная ценность клиента), повторные покупки, retention rate, снижение оттока и вклад персонализации в общий ROI маркетинга. Кроме количественных показателей важно отслеживать качество рекомендаций: разнообразие каталога в рекомендациях, доля новых товаров в наборе рекомендаций, и метрики справедливости/непредвзятости. Для корректной интерпретации необходимо:

1. Проводить A/B тестирование с разделением трафика и контрольной группой; измерять не только uplift в краткосрочных метриках, но и смещение совокупного дохода.

2. Контролировать сегментные эффекты: персонализация может улучшать результаты в одних когортных сегментах и ухудшать в других; важно анализировать по когорте по источнику трафика, по устройству и по жизненному циклу клиента.

3. Учитывать внешние факторы: промо-акции, сезонность и маркетинговые кампании, которые влияют на метрики и могут смещать результаты эксперимента.

4. Оценивать статистическую значимость и стабилизацию эффекта во времени, чтобы исключить ложные положительные повышения.

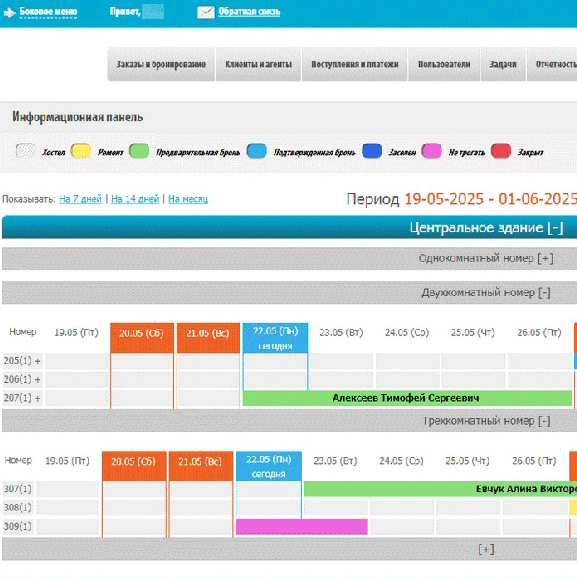

Отдельно мы рекомендуем внедрять KPI по стоимости рекомендаций: стоимость демонстрации и обслуживания модели против дополнительного дохода. В наших проектах мы формируем дашборды с реальным временем мониторинга и alert-системами на дрифт и падение KPI, чтобы обеспечить быструю реакцию и ретренинг моделей. Цена внедрения и поддержки персонализации обычно обсуждается отдельно, ориентиры начинаются от 8611 при пакетной оценке для малого и среднего бизнеса.

Каковы этапы внедрения Ai персонализации в существующую маркетинговую инфраструктуру и сколько времени занимает проект?

Внедрение персонализации — комплексный проект, проходящий по этапам, каждый из которых требует согласований и тестирования. Основная поэтапная схема:

1. Диагностика и сбор требований: аудит текущих данных, систем (CRM, CDP, CMS, рекламные платформы), целей бизнеса и KPI. Результат — техническое задание и дорожная карта.

2. Подготовка данных и интеграция: настройка трекинга, экспортов, потоков данных, нормализация и очистка; возможно внедрение CDP.

3. Построение первичных моделей и прототипа: быстрые MVP-рекомендации и правила для запуска, чтобы получить ранние результаты.

4. Тестирование и запуск в продакшен: A/B тесты, валидация, мониторинг показателей качества и инфраструктуры.

5. Оптимизация и масштабирование: обучение более сложных моделей, внедрение real-time inference, автоматизация ретренинга и мониторинга.

6. Поддержка и улучшение: регулярный анализ дрифта, добавление новых фичей, обучение команды.

Временные рамки зависят от готовности инфраструктуры и объёма данных: при наличии базовой инфраструктуры MVP можно запустить за 6-8 недель; при необходимости значительной интеграции и построения CDP проект занимает 3-6 месяцев до первого стабильного релиза. Риски и факторы, удлиняющие сроки: отсутствие единых идентификаторов пользователей, низкое качество данных, сложная интеграция с legacy-системами. Мы работаем по прозрачному плану с этапами и контрольными точками, предоставляем документацию и обучение команд. Компания АвикейВлж работает с 2011 года и мы реализуем проекты с поэтапной отдачей ценности; при заказе услуги под ключ скидка от 15 процентов. Для оперативных консультаций используйте номер +7 936 21-84-28 или напишите в службу поддержки; Мы работаем Пн1-Пт 09-18 Сб-Вс вых.